Seguridad en Sistemas Autónomos con Aprendizaje Automático

El auge de los sistemas autónomos marca el comienzo de una era de innovación sin precedentes, prometiendo revolucionar el transporte, la manufactura, la logística y numerosos aspectos de la vida cotidiana. Desde vehículos autónomos que se desplazan por calles bulliciosas hasta robots inteligentes que colaboran en fábricas, estos sistemas tienen el potencial de lograr una eficiencia, seguridad y comodidad notables. Sin embargo, bajo esta promesa brillante se encuentra un desafío formidable: garantizar su seguridad y fiabilidad inquebrantables.

El camino hacia la autonomía total está lleno de complejidades, requiriendo no solo un gran dominio tecnológico, sino también una comprensión profunda y matizada de los riesgos inherentes, en particular aquellos introducidos por el propio núcleo de estos sistemas – Aprendizaje Automático (ML).

En 4Geeks, no solo observamos esta transformación; la moldeamos activamente. Como expertos experimentados en soluciones avanzadas de Aprendizaje Automático, reconocemos que la verdadera medida de la innovación en sistemas autónomos no es simplemente su capacidad, sino su fiabilidad. Nuestra misión es incorporar la seguridad en el núcleo de estas entidades inteligentes, transformando posibles peligros en pilares de operaciones autónomas robustas, fiables y, en última instancia, más seguras. Esto no se trata solo de escribir código; se trata de construir confianza, mitigar riesgos y fomentar un futuro en el que la autonomía sirva a la humanidad sin compromisos.

Servicios de ingeniería de LLM y IA

Ofrecemos una completa gama de soluciones impulsadas por IA, que incluyen IA generativa, visión artificial, aprendizaje automático, procesamiento del lenguaje natural y automatización basada en IA.

El auge imparable de la autonomía y la necesidad imperiosa de seguridad

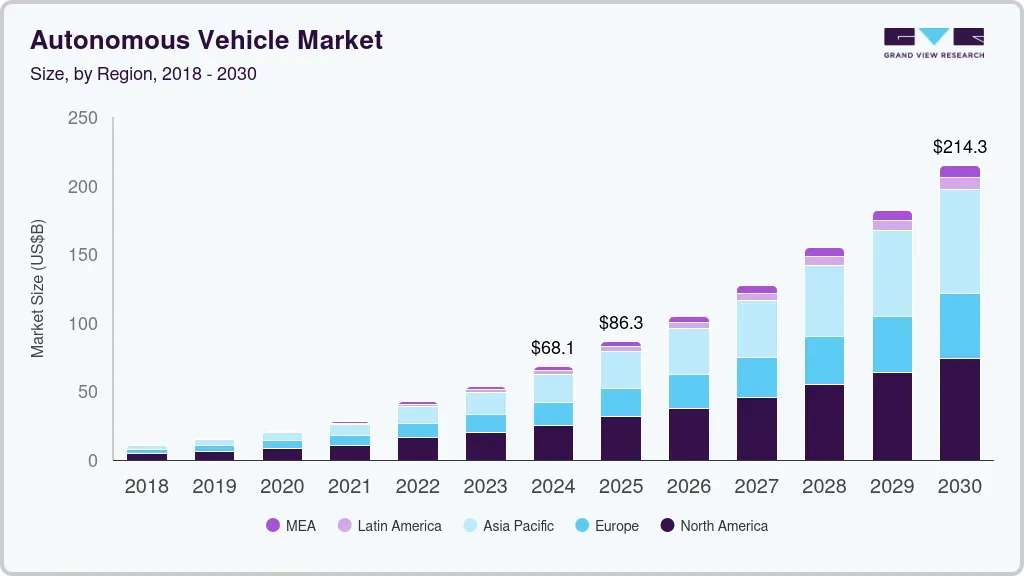

El mercado global de sistemas autónomos está experimentando un crecimiento exponencial, lo que demuestra el poder transformador que ejercen estas tecnologías. Las proyecciones indican que el mercado global de vehículos autónomos por sí solo se espera que alcance aproximadamente 1,8 billones de dólares para 2030USD 1.8 billones para 2030Grand View Research). Este rápido crecimiento no se limita a los vehículos; abarca un ecosistema en expansión de drones autónomos para la entrega y la vigilancia, robótica inteligente en la fabricación avanzada y una sofisticada automatización en la infraestructura crítica.

Sin embargo, con gran poder viene gran responsabilidad – y un riesgo significativo. La integración de modelos de aprendizaje automático complejos en aplicaciones críticas para la seguridad eleva un simple error de software en un posible desastre. Un pequeño error de cálculo en el sistema de percepción de un automóvil autónomo podría provocar un accidente. Un fallo en la navegación de un robot industrial podría causar lesiones graves o daños. Las consecuencias son enormes, afectando no solo la vida humana y la producción económica, sino también la confianza pública y la aceptación regulatoria. La necesidad de seguridad no es una característica; es el requisito fundamental para la adopción generalizada y el beneficio social de los sistemas autónomos.

Considere las posibles consecuencias: además del daño físico inmediato, existe una importante carga financiera. Cada accidente que involucre un sistema autónomo puede generar enormes responsabilidades, costos de seguros y daños irreparables a la imagen de la marca. Por ejemplo, los datos de la Administración Nacional de Seguridad del Tráfico en Carretera (NHTSA) a menudo destacan los costes humanos y económicos de los accidentes de tráfico, lo que subraya la necesidad crítica de que los sistemas autónomos demuestren un historial de seguridad significativamente superior. (Fuente: Datos de Seguridad del Tráfico de la NHTSA). Esto no se trata solo de evitar el fracaso; se trata de diseñar la resistencia ante lo inesperado, lo improbable e incluso lo malicioso.

Aprendizaje automático: El cerebro y la vulnerabilidad de los sistemas autónomos

En el corazón de los sistemas autónomos modernos se encuentra el Aprendizaje Automático. Es lo que les permite "percibir" su entorno, "comprender" situaciones complejas, "tomar" decisiones inteligentes y "adaptarse" a condiciones dinámicas. Ya sea que se trate de algoritmos de visión artificial que identifican peatones y señales de tráfico, modelos de aprendizaje por refuerzo que optimizan las rutas de navegación o análisis predictivo que anticipa fallas en el equipo, el Aprendizaje Automático es la red neuronal que impulsa la autonomía.

Específicamente, los modelos de ML destacan en:

- Percepción: Interpretar datos de sensores provenientes de cámaras, LiDAR, radar y ultrasonidos para construir una comprensión en tiempo real del entorno. Las arquitecturas de aprendizaje profundo, como las Redes Neuronales Convolucionales (CNN), han revolucionado la detección de objetos y la segmentación semántica.

- Toma de decisiones y control: Aprender estrategias óptimas para la navegación, la planificación de rutas y la interacción con el entorno. Los agentes de Aprendizaje por Refuerzo (RL), por ejemplo, pueden aprender políticas de control robustas a través de la prueba y el error en escenarios simulados o del mundo real.

- Predicción: Predecir estados futuros, como la trayectoria de otros vehículos o la aparición de fallos en equipos. Las Redes Neuronales Recurrentes (RNN) y los modelos transformadores se utilizan cada vez más para tareas de predicción de secuencias.

- Interacción humano-máquina: Comprender comandos en lenguaje natural, interpretar gestos y proporcionar retroalimentación intuitiva a los operadores humanos.

Sin embargo, las profundas capacidades del aprendizaje automático introducen un conjunto de desafíos únicos que son fundamentalmente diferentes del software basado en reglas tradicional. A diferencia del código determinista, los modelos de aprendizaje automático aprenden de los datos, y su comportamiento puede ser altamente no lineal, opaco y sensible a las variaciones de entrada. Esta complejidad inherente hace que garantizar la seguridad sea una tarea ardua, que requiere enfoques innovadores para el diseño, las pruebas y la implementación.

Navegando por el camino peligroso: Desafíos para la seguridad de la IA

Si bien el aprendizaje automático ofrece una adaptabilidad sin precedentes, también presenta vulnerabilidades distintas que deben abordarse rigurosamente para garantizar la seguridad. Estos desafíos no son teóricos; son obstáculos reales que, en algunos casos, han provocado fallos críticos.

El Dilema de la Dependencia de Datos: Sesgos, Calidad y Casos Extremos

Los modelos de aprendizaje automático solo son tan buenos como los datos en los que se entrenan. Si los datos son sesgados, incompletos o de mala calidad, el modelo hereda estas deficiencias, lo que puede provocar un comportamiento poco fiable y potencialmente inseguro. Por ejemplo, los sistemas de reconocimiento facial entrenados principalmente con un único grupo demográfico pueden mostrar una precisión significativamente menor para otros, lo que plantea preocupaciones éticas y prácticas. (Fuente: Estudio del NIST sobre sesgos en el reconocimiento facial

Más allá de los sesgos, el enorme volumen y la diversidad de datos necesarios para cubrir cada escenario operativo imaginable para un sistema autónomo son asombrosos. El problema de los "casos excepcionales" – circunstancias raras e imprevistas que no estaban presentes en los datos de entrenamiento – sigue siendo un obstáculo principal. Se estima que los vehículos autónomos registran millones de millas de pruebas para encontrar solo una fracción de estos escenarios únicos. Por ejemplo, un informe de seguridad de Waymo describió un incidente en el que su vehículo autónomo tuvo dificultades para clasificar correctamente un automóvil dañado que estaba siendo empujado por una persona, lo que destacaba la dificultad de prepararse para todas las interacciones únicas del mundo real. (Fuente: Informe de seguridad de Waymo V2, página 19, Informe de seguridad de Waymo

El "problema de la Caja Negra": Explicabilidad y Confianza

Muchos modelos de aprendizaje automático potentes, especialmente las redes neuronales profundas, operan como "cajas negras." Sus procesos de toma de decisiones a menudo son opacos, lo que dificulta que los operadores o ingenieros comprendan ¿por qué?por qué

Cuando un sistema autónomo falla, comprender la causa raíz es fundamental para el aprendizaje y la mejora. Si la IA no puede explicar su razonamiento, el diagnóstico de problemas se convierte en un proceso complejo, que consume mucho tiempo y a menudo es especulativo. Esta falta de transparencia impacta directamente en nuestra capacidad para certificar estos sistemas como seguros, ya que los reguladores a menudo exigen pruebas concretas y justificaciones claras para las decisiones tomadas en situaciones críticas.

Robustez ante ataques: La amenaza de manipulación maliciosa

Una vulnerabilidad preocupante en los sistemas de aprendizaje automático es su susceptibilidad a ataques de adversarios. Estos implican perturbar sutilmente los datos de entrada de una manera que es imperceptible para los humanos, pero que provoca que el modelo clasifique incorrectamente o se comporte de manera errónea. Por ejemplo, unos pocos adhesivos colocados estratégicamente en un semáforo podrían engañar al sistema de visión de un coche autónomo para que lo clasifique como un letrero de límite de velocidad, con consecuencias potencialmente fatales. La investigación ha demostrado que incluso los clasificadores de imágenes de última generación pueden ser engañados con alta confianza mediante estos ataques. (Fuente: Investigación de OpenAI: Ejemplos adversarios robustos).

A medida que los sistemas autónomos se integran cada vez más en nuestra infraestructura, el riesgo de ataques cibernéticos y físicos dirigidos a estas vulnerabilidades de IA aumenta. Protegerse contra estas amenazas sofisticadas requiere una estrategia de seguridad proactiva y multicapa que vaya más allá de las medidas de ciberseguridad convencionales.

Verificación y Validación: Demostrar la seguridad en un mundo infinito

Tradicionalmente, la seguridad del software se garantiza a través de pruebas rigurosas y verificación formal. Sin embargo, para los sistemas autónomos impulsados por el aprendizaje automático, el gran número de posibles entradas y estados ambientales hace que las pruebas exhaustivas sean prácticamente imposibles. ¿Cómo se puede demostrar que un modelo de aprendizaje automático nuncanunca

Los métodos actuales a menudo implican una extensa conducción en el mundo real y simulaciones. Por ejemplo, Waymo informa de miles de millones de millas simuladas y millones de millas reales registradas por su flota autónoma. (Fuente: Informe de seguridad de Waymo). Si bien es esencial, esta escala de pruebas es extremadamente costosa y aún no garantiza la cobertura de todos los eventos "de cuello de botella". El desarrollo de marcos de verificación y validación (V&V) robustos, específicamente diseñados para el aprendizaje automático, es uno de los desafíos más importantes que enfrenta la industria.

Construyendo Fortalezas de Seguridad: Soluciones Avanzadas de ML de 4Geeks

En 4Geeks, transformamos estos desafíos complejos en problemas de ingeniería que pueden resolverse. Nuestro enfoque va más allá de la simple implementación; diseñamos la seguridad en el propio tejido de la inteligencia autónoma utilizando principios de vanguardia de Aprendizaje Automático e ingeniería de datos.

Estrategias de datos robustas: La base de la fiabilidad

Reconociendo que los datos son la base del aprendizaje automático, 4Geeks se especializa en la creación de robustos flujos de datos diseñados para aplicaciones críticas en seguridad. Nuestros servicios abarcan:

- Recopilación y gestión de datos inteligentes: Diseñamos estrategias para recopilar datos diversos y de alta calidad que sean representativos del dominio operativo objetivo, identificando y mitigando activamente los sesgos desde el principio. Esto incluye el uso de técnicas de fusión de sensores para crear conjuntos de datos más ricos.

- Etiquetado y ampliación de datos avanzados: Nuestros equipos utilizan herramientas y técnicas de etiquetado sofisticadas, incluyendo segmentación semántica y cuadros delimitadores 3D, proporcionando etiquetas precisas que son cruciales para los modelos de percepción. También empleamos la generación de datos sintéticos para crear casos límite desafiantes que son poco prácticos o peligrosos de recopilar en el mundo real, ampliando considerablemente la cobertura del conjunto de datos de entrenamiento. Por ejemplo, generar variaciones de condiciones climáticas o escenarios de tráfico inusuales.

- Aprendizaje activo para casos límite: En lugar de recopilar datos pasivamente, implementamos bucles de aprendizaje activo que identifican de forma inteligente los puntos de datos en los que el modelo es más incierto o propenso a errores. Esto permite la adquisición y el etiquetado de datos dirigidos, mejorando de forma eficiente el rendimiento del modelo en escenarios desafiantes.

- Marcos de detección y mitigación de sesgos: Integramos herramientas y metodologías para detectar y corregir sistemáticamente los sesgos dentro de los conjuntos de datos y los modelos, garantizando un rendimiento equitativo y seguro en todas las condiciones de funcionamiento y demográficas.

Servicios de Ingeniería de LLM y IA

Ofrecemos una completa gama de soluciones impulsadas por la IA, que incluyen IA generativa, visión artificial, aprendizaje automático, procesamiento del lenguaje natural y automatización con IA.

Inteligencia Artificial Explicable (XAI) e Interpretabilidad: Desmitificando la Caja Negra

Para fomentar la confianza y facilitar la depuración rápida, 4Geeks integra directamente las técnicas de Inteligencia Artificial Explicable (XAI) en nuestras soluciones de aprendizaje automático. Entendemos que "por qué" es tan importante como "qué".

- Herramientas de Explicación Post-hoc: Utilizamos técnicas como LIME (Modelos Explicables e Interpretables, Agnostic) y SHAP (Explicaciones Aditivas de Shapley) para proporcionar información sobre las predicciones individuales del modelo, destacando qué características de entrada contribuyeron más a una decisión específica. Esto es invaluable durante el análisis de incidentes y la depuración.

- Modelos Inheritamente Interpretables: Cuando sea apropiado, promovemos y construimos modelos que son inherentemente más interpretables, como árboles de decisión o modelos aditivos generalizados, sin sacrificar el rendimiento necesario.

- Mecanismos de Atención y Visualización de Características: Para modelos de aprendizaje profundo, utilizamos mecanismos de atención para resaltar visualmente las partes de los datos de entrada (por ejemplo, píxeles en una imagen) que el modelo consideró al tomar una decisión, ofreciendo una visión transparente de su "proceso de pensamiento".

- Inferencia Causal: Más allá de la correlación, exploramos técnicas de inferencia causal para comprender las relaciones causales subyacentes que rigen el comportamiento del sistema, lo que conduce a acciones autónomas más robustas y predecibles.

Robustez y seguridad frente a ataques: Fortalecer la defensa contra la manipulación

Reconociendo la creciente amenaza de los ataques adversarios, 4Geeks diseña e implementa sistemas de ML con seguridad integrada desde la concepción.

- Estrategias de entrenamiento defensivo: Utilizamos técnicas como el entrenamiento adversarial, donde los modelos se exponen a ejemplos adversarios durante el entrenamiento, haciéndolos más resistentes a futuros ataques.

- Sanitización de la entrada y detección de anomalías: Implementamos capas de preprocesamiento sofisticadas para detectar y filtrar entradas maliciosas antes de que lleguen al modelo de ML central. Esto incluye el uso de autoencoders o métodos estadísticos para identificar patrones inusuales que indiquen un ataque.

- Arquitecturas robustas: Diseñamos arquitecturas de redes neuronales que son inherentemente más resistentes a pequeñas perturbaciones, incorporando capas de ruido y funciones de activación robustas.

- Pipelines de ML seguros: Más allá del propio modelo, garantizamos que todo el pipeline de ML – desde la ingestión de datos hasta el despliegue del modelo – cumpla con los más altos estándares de ciberseguridad, protegiendo contra la manipulación de datos, el robo de modelos y las violaciones de la integridad.

- Aprendizaje federado para privacidad y seguridad: Para escenarios que requieren datos sensibles, implementamos enfoques de aprendizaje federado, lo que permite que los modelos se entrenen en conjuntos de datos descentralizados sin que los datos salgan de su origen, mejorando tanto la privacidad como reduciendo la superficie de ataque. (Fuente: Blog de Google AI sobre Aprendizaje Federado).

Marcos avanzados de verificación y validación (V&V): Demostrando una seguridad inexpugnable

Garantizar la seguridad requiere más que simplemente buenos modelos; exige un enfoque riguroso y sistemático para demostrar su fiabilidad en todas las condiciones. 4Geeks desarrolla marcos de V&V (verificación y validación) personalizados, adaptados para sistemas autónomos complejos.

- Simulación de Alta Fidelidad y Gemelos Digitales: Aprovechamos entornos de simulación de última generación, creando "gemelos digitales" de escenarios del mundo real. Estas simulaciones permiten realizar pruebas exhaustivas de modelos de ML contra millones de escenarios diversos, incluyendo eventos raros y peligrosos que no pueden reproducirse de forma segura en pruebas físicas. Esto reduce drásticamente el coste y el tiempo de validación, al tiempo que aumenta la cobertura. Se estima que las simulaciones pueden reducir los costes de pruebas de vehículos autónomos en órdenes de magnitud en comparación con la conducción en el mundo real. (Fuente: Diversos informes de la industria, por ejemplo, McKinsey & Company sobre la conducción autónoma

- Métodos Formales y Verificación de Modelos: Para componentes o reglas de decisión críticos y relevantes para la seguridad, empleamos técnicas de verificación formal. Estos métodos matemáticos demuestran la corrección de los algoritmos frente a propiedades especificadas, ofreciendo el mayor nivel de garantía para partes específicas del sistema.

- Pruebas Basadas en Escenarios y Métricas de Cobertura: Definimos bibliotecas de escenarios exhaustivas, desde situaciones de conducción comunes hasta casos extremos complejos, y desarrollamos métricas sofisticadas para garantizar una cobertura de pruebas adecuada, identificando lagunas donde el modelo podría estar sub-probado.

- Integración/Despliegue Continuos (CI/CD) para ML (MLOps): Nuestra experiencia en MLOps garantiza que la validación y verificación (V&V) es un proceso continuo. Las pruebas automatizadas, la supervisión de modelos y las tuberías de reentrenamiento garantizan que la seguridad de los sistemas autónomos se mantiene a lo largo de su ciclo de vida, adaptándose a nuevos datos y entornos en evolución.

Cuantificación de la incertidumbre: Saber qué no sabe el modelo

Un sistema autónomo verdaderamente seguro no solo realiza predicciones, sino que también comprende sus propias limitaciones y expresa su confianza en esas predicciones. Es aquí donde la Cuantificación de la Incertidumbre (UQ) se vuelve crucial.

- Redes Neuronales Bayesianas (RNBs): Implementamos RNBs, que proporcionan una distribución de probabilidad sobre sus predicciones, permitiendo que el modelo exprese su incertidumbre. Una alta incertidumbre en una situación crítica puede desencadenar una intervención humana o una maniobra de respaldo segura.

- Métodos de Ensamble: Al combinar las predicciones de múltiples modelos diversos, los métodos de ensamble pueden proporcionar una salida más robusta y menos volátil, a menudo acompañada de una medida de desacuerdo entre los modelos, lo que indica incertidumbre.

- Puntuaciones de Confianza y Detección de Anomalías: Nuestras soluciones integran puntuaciones de confianza en cada predicción, permitiendo que el sistema señale salidas con baja confianza para su revisión por un humano o para que adopte comportamientos alternativos y más conservadores. Los algoritmos de detección de anomalías pueden identificar entradas que están muy fuera de la distribución de entrenamiento, lo que indica un escenario de alto riesgo.

Diseño de IA Ético: Incorporación de la Autonomía Responsable

La seguridad se extiende más allá de la robustez técnica para abarcar las consideraciones éticas. 4Geeks ayuda a los clientes a desarrollar sistemas de IA que sean justos, responsables y transparentes.

- Auditorías de equidad y mitigación de sesgos: Realizamos auditorías exhaustivas de equidad, identificando y mitigando los sesgos que podrían conducir a resultados discriminatorios o inseguros para grupos específicos.

- Sistemas con intervención humana (HITL): Para decisiones altamente complejas o de alto riesgo, diseñamos arquitecturas HITL, donde los operadores humanos pueden supervisar, intervenir y proporcionar retroalimentación, creando una relación simbiótica entre la IA y la inteligencia humana. Esto garantiza la rendición de cuentas y permite una degradación gradual en circunstancias imprevistas.

- Rastreo y auditabilidad: Nuestros sistemas están diseñados para una completa trazabilidad, registrando cada decisión y los datos que la informaron, lo que permite auditorías y rendición de cuentas exhaustivas para acciones autónomas.

4Geeks: Tu socio de confianza para un futuro autónomo más seguro

El camino para construir sistemas autónomos verdaderamente seguros y fiables es complejo, requiriendo un enfoque multidisciplinario, un profundo conocimiento y un compromiso con la innovación continua. Aquí es donde 4Geeks se convierte en su socio indispensable.

Experiencia Profunda, Trayectoria Comprobada: Nuestro equipo está formado por especialistas líderes en aprendizaje automático, ética de la IA, ingeniería de datos y MLOps. Contamos con una trayectoria comprobada en la entrega de soluciones avanzadas de ML en diversas industrias, abordando algunos de los problemas técnicos más desafiantes. No solo entendemos la teoría; construimos los sistemas prácticos y desplegables que funcionan en el mundo real.

Soluciones Integrales con un Enfoque Centrado en la Seguridad: Desde la estrategia inicial y la conceptualización hasta la construcción de la canalización de datos, el desarrollo de modelos, la validación rigurosa y el mantenimiento continuo, 4Geeks ofrece servicios integrales y completos. Nuestra metodología se basa intrínsecamente en la seguridad, integrando técnicas robustas de V&V, XAI y robustez ante ataques en cada etapa del ciclo de vida del desarrollo. Le ayudamos a navegar por el panorama regulatorio y a construir sistemas que cumplen con los más altos estándares de seguridad.

Enfoque personalizado, ágil y colaborativo: Entendemos que ningún proyecto de sistema autónomo es idéntico. Trabajamos estrechamente con sus equipos, adoptando un enfoque ágil y colaborativo para adaptar soluciones específicamente a sus requisitos operativos, objetivos comerciales y perfiles de riesgo únicos. Actuamos como una extensión de sus capacidades de ingeniería, aportando conocimientos especializados y acelerando su camino hacia el mercado con confianza.

Compromiso con la IA ética: Más allá de la seguridad técnica, 4Geeks está profundamente comprometido con el desarrollo de la IA ética. Guiamos a nuestros socios para que construyan sistemas que no solo son seguros y fiables, sino también justos, transparentes y responsables, fomentando la confianza pública y garantizando beneficios sociales a largo plazo.

Innovación en el núcleo: El campo de la IA está en constante evolución. En 4Geeks, nos mantenemos a la vanguardia de la investigación y el desarrollo, integrando continuamente los últimos avances en IA robusta, aprendizaje automático causal e interpretabilidad para garantizar que sus sistemas autónomos estén equipados con los mecanismos de seguridad más avanzados disponibles.

Servicios de Ingeniería de LLM y IA

Ofrecemos una completa gama de soluciones impulsadas por IA, que incluyen IA generativa, visión artificial, aprendizaje automático, procesamiento del lenguaje natural y automatización con IA.

Finalmente

La visión de un mundo empoderado por sistemas autónomos está al alcance, prometiendo un futuro de eficiencia, comodidad y, potencialmente, mayor seguridad en muchos ámbitos. Sin embargo, lograr este futuro de manera responsable depende completamente de nuestra capacidad para diseñar estos sistemas inteligentes con un compromiso inquebrantable con la seguridad y la fiabilidad. Las inherentes complejidades del Aprendizaje Automático – sus dependencias de datos, su toma de decisiones opaca, su vulnerabilidad a ataques adversos y la monumental tarea de verificación – presentan importantes obstáculos que no pueden superarse únicamente con los paradigmas convencionales de desarrollo de software.

Las consecuencias son simplemente demasiado altas. Un fallo crítico en un sistema autónomo puede tener consecuencias devastadoras para los humanos, económicas y de reputación, erosionando la confianza pública y frenando el ritmo de la innovación. Abordar estos desafíos requiere más que simplemente construir modelos de IA potentes; exige un enfoque integral, sofisticado y proactivo para la ingeniería de la seguridad de la IA. Esto implica pasar de la depuración reactiva a un diseño proactivo para la resiliencia, la interpretabilidad y la confiabilidad demostrable. Aquí es donde 4Geeks destaca, transformando la promesa de la autonomía en una realidad tangible y segura.

En 4Geeks, creemos que la verdadera medida del éxito para los sistemas autónomos reside no solo en su capacidad para realizar tareas complejas, sino también en su inquebrantable fiabilidad en un espectro infinito de condiciones del mundo real. Nuestras avanzadas soluciones de Aprendizaje Automático están meticulosamente diseñadas para abordar los desafíos de seguridad más difíciles de manera directa. Empoderamos a las organizaciones para que construyan sistemas autónomos que no solo son inteligentes, sino también profundamente confiables – sistemas que comprenden sus limitaciones, pueden explicar sus decisiones, son resistentes a la manipulación y están rigurosamente validados contra todos los riesgos concebibles.

No somos simplemente proveedores; somos socios estratégicos en el desarrollo de la próxima generación de aplicaciones inteligentes, especialmente relevantes para la seguridad. Nuestra profunda experiencia en estrategias de datos sólidas, inteligencia artificial explicable de última generación, robustez proactiva contra ataques y rigurosos marcos de verificación y validación, permite a nuestros clientes navegar con confianza por el intrincado panorama de la seguridad de la IA. Al colaborar con 4Geeks, usted obtiene acceso a un equipo de expertos dedicados, comprometidos a integrar la seguridad y las consideraciones éticas en cada capa de su ecosistema autónomo. Juntos, podemos aprovechar todo el potencial de la autonomía, creando sistemas que no solo son innovadores en sus capacidades, sino también ejemplares en su fiabilidad y confianza pública.

Construyamos juntos un futuro más seguro y autónomo.

Preguntas frecuentes

¿Cuáles son los principales desafíos de seguridad para los sistemas autónomos?

Los principales desafíos se derivan de su dependencia del Aprendizaje Automático (ML). Estos incluyen el problema de la "caja negra", donde la toma de decisiones de una IA es opaca; la vulnerabilidad a los sesgos en los datos que pueden conducir a malas decisiones; y el riesgo de ataques adversarios, donde las entradas son manipuladas maliciosamente para causar el fallo del sistema.

¿Qué es un ataque adversarial en el contexto de sistemas autónomos?

Un ataque adversarial es una técnica maliciosa utilizada para engañar a un modelo de aprendizaje automático. Para un sistema autónomo, esto podría implicar alterar sutilmente un objeto físico, como colocar pegatinas en un semáforo, para que el sistema lo clasifique incorrectamente (p. ej., como un letrero de límite de velocidad) y se comporte de forma peligrosa.

¿Cómo se pueden hacer que los modelos de Aprendizaje Automático para sistemas autónomos sean más seguros y confiables?

La seguridad se mejora a través de varias estrategias clave. Estas incluyen la creación de robustos flujos de datos para reducir los sesgos y cubrir los "casos extremos", la implementación de la IA Explicable (XAI) para que los operadores humanos puedan comprender el razonamiento de una IA, y la realización de pruebas y validaciones rigurosas (V&V) para probar la capacidad del sistema frente a un número infinito de posibilidades del mundo real.